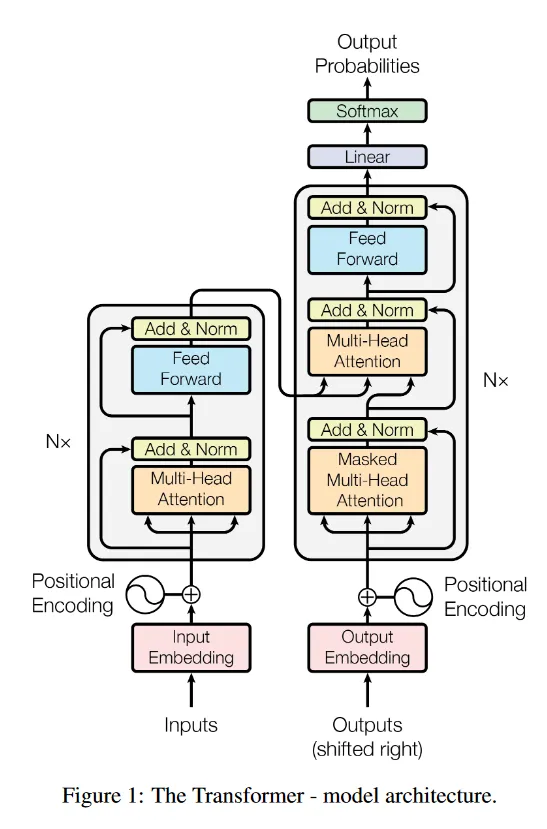

사실 알고는 있지만 블로그로 이해했기 때문에..논문을 제대로 읽어보았습니다!!파이팅. 0. Abstract단순히 attention 메커니즘만으로 이루어진 모델로 RNN과 CNN을 성능으로 이길 수 있음실험을 통해 알아낸 장점으로는 더 높은 품질, 병렬처리 가능 그리고 훈련 시간 단축이 있었음1. Introduction언어 모델이나 기계 번역 같은 문제에서 RNN, LSTM과 같이 sequence 모델링이나 번역 분야에서 SOTA였음Recurrent 모델은 입력과 출력의 위치에 따라서 연산을 수행하는데, 병렬 처리가 불가능하기 때문에 긴 time sequence에서 효율적이지 못함Attention 메커니즘은 굉장히 중요한 파트가 되었지만 여전히 RNN과 연결하여 사용함 → 효율적인 병렬화가 불가능 ..